Jedes Mal, wenn Ihr Backend eine unnötige Datenbankabfrage startet, verbrennt ungesehen Energie. Wir sehen die Abgase des Internets zwar nicht, doch sie belasten unser Klima massiv. Erfahren Sie in unserem Deep-Dive, wie "Green Coding" funktioniert, wie Sie heimliche Stromfresser im Rechenzentrum aufspüren und warum minimalistischer Code der Schlüssel zu nachhaltiger Software ist.

Die unsichtbare Last der Digitalisierung: Ein Klick, ein Funke

Stellen Sie sich für einen kurzen Moment Folgendes vor: Jedes Mal, wenn ein Besucher Ihre Website lädt oder eine Funktion in Ihrer App nutzt, flammt auf Ihrem Schreibtisch eine kleine, altmodische Glühbirne auf. Ein flüchtiges, sanftes Aufblitzen für einen simplen Klick. Ein intensives, sekundenlanges und heißes Glimmen, wenn eine komplexe Suchanfrage durch Ihre Datenbank rattert. Wenn Sie einen gut besuchten Online-Shop betreiben, würde Ihr Büro wahrscheinlich in kürzester Zeit taghell erstrahlen. Wie lange würde diese Lampe brennen, bevor sie vor Erschöpfung durchbrennt? Und wie unerträglich heiß würde es in Ihrem Zimmer werden?

Diese greifbare, beinahe schmerzhafte Vorstellung verdeutlicht ein massives Problem unserer Zeit: Wir spüren das physische Gewicht unserer digitalen Daten nicht.

Wir sehen die Abgase des Internets nicht in den Himmel steigen. Es existiert kein stinkender Auspuff an unseren schlanken Laptops, kein rußender Schornstein an unseren blitzblanken Smartphones. Diese sterile, leise Fassade der Endgeräte täuscht uns gewaltig. Sie verschleiert die handfeste, schmutzige Realität unserer geliebten digitalen Welt. Warum ist diese schmerzhafte Erkenntnis heute so wichtig? Weil die Informationstechnologie mittlerweile einen globalen CO2-Fußabdruck hinterlässt, der mit dem der gesamten weltweiten Luftfahrtindustrie konkurriert. Jeder gestreamte Film, jede versendete E-Mail und eben auch jeder noch so kleine API-Call verbraucht echten Strom. Und solange dieser Strom nicht zu hundert Prozent aus erneuerbaren Quellen stammt, bedeutet das unweigerlich: Treibhausgase entweichen in unsere ohnehin belastete Atmosphäre.

Aber wer trägt eigentlich die Verantwortung dafür? Sind es nur die großen Cloud-Anbieter wie Amazon, Google und Microsoft, die ihre gigantischen Rechenzentren grüner machen müssen? Absolut nicht. Hier kommt ein Konzept ins Spiel, das unsere Entwicklerkultur von Grund auf revolutionieren muss: Green Coding.

Haben Sie sich jemals gefragt, ob eine elegante Software-Architektur mehr ist als nur ein intellektuelles Fest für das Auge eines anderen Entwicklers? Die Antwort lautet schlichtweg: Ja! Eine smarte Architektur rettet buchstäblich Ressourcen. Auf der untersten, rohesten Ebene der Physik bedeutet das Ausführen von Code, dass Milliarden winziger Transistoren in einem weit entfernten Prozessor geschaltet werden. Dieser elementare, mikroskopische Vorgang erfordert elektrische Energie. Gleichzeitig erzeugt er Abwärme, die wiederum durch gigantische, stromfressende Klimaanlagen in den Rechenzentren mühsam heruntergekühlt werden muss. Es ist ein doppelter Energieaufwand für jede noch so kleine Berechnung.

Jedes Mal, wenn Ihr Backend eine unnötige Datenbankabfrage startet, weil der Cache nicht optimal konfiguriert ist, verbrennen Sie unwiederbringlich Energie. Es ist, als würden Sie für jedes einzelne Blatt Papier, das Sie aus dem Archiv im tiefsten Keller benötigen, separat die dunklen Treppen hinunter- und wieder hinauflaufen, anstatt gleich den ganzen Aktenordner mitzunehmen. Solche Ineffizienzen mögen im Einzelfall unbedeutend, fast schon banal erscheinen. Doch im globalen Maßstab des Internets summieren sie sich sekündlich millionenfach.

Wenn ein Backend-Entwickler heute ein neues Feature entwirft, gleicht er einem Architekten, der das Straßennetz einer wachsenden Millionenmetropole plant. Baut er direkte, kurze und flüssige Wege? Oder schickt er den unschuldigen Datenverkehr durch ein Labyrinth aus redundanten Schleifen, toten Winkeln und ineffizienten Joins? Ein hastig geschriebenes SELECT * auf einer riesigen, nicht indizierten Tabelle ist längst nicht mehr nur technologisch schlechter Stil. Es ist eine handfeste Umweltsünde. Die Festplatten rotieren lautlos auf, der Arbeitsspeicher füllt sich bis zum Anschlag, der Prozessor taktet unter Volllast hoch. All das vielleicht für versteckte Datenfragmente, die im Frontend des Nutzers niemals das Licht der Welt erblicken werden.

Wir müssen anfangen, unseren Code als aktiven Teilnehmer am Ökosystem zu betrachten. Im nächsten Schritt werden wir genauer beleuchten, wie die Wahl des physischen "Wohnorts" unserer Daten – der Server-Standort – unsere Klimabilanz drastisch verändern kann.

Die Geografie der Cloud: Wo genau "wohnt" Ihr Code?

Was genau ist eigentlich diese allgegenwärtige "Cloud", von der wir täglich so selbstverständlich schwärmen? In unserer Vorstellung gleicht sie oft einem schwerelosen, flüchtigen Nebelgebilde, das sanft und unsichtbar über unseren Köpfen schwebt. Eine poetische, aber fatale Täuschung der Tech-Industrie. Die Realität ist massiv, brummend und aus hartem Beton gegossen. Es handelt sich um gigantische, fensterlose Hochsicherheitshallen, durchzogen von abertausenden Kilometern an dicken Kupferkabeln, ohrenbetäubend lauten Lüftungsanlagen und endlosen, flimmernden Reihen von Server-Racks. Und vor allem: Diese physische Infrastruktur steht immer irgendwo fest auf unserem Planeten verankert. Genau dieser geografische Standort ist der größte, oft völlig ignorierte Hebel für Ihre digitale Klimabilanz.

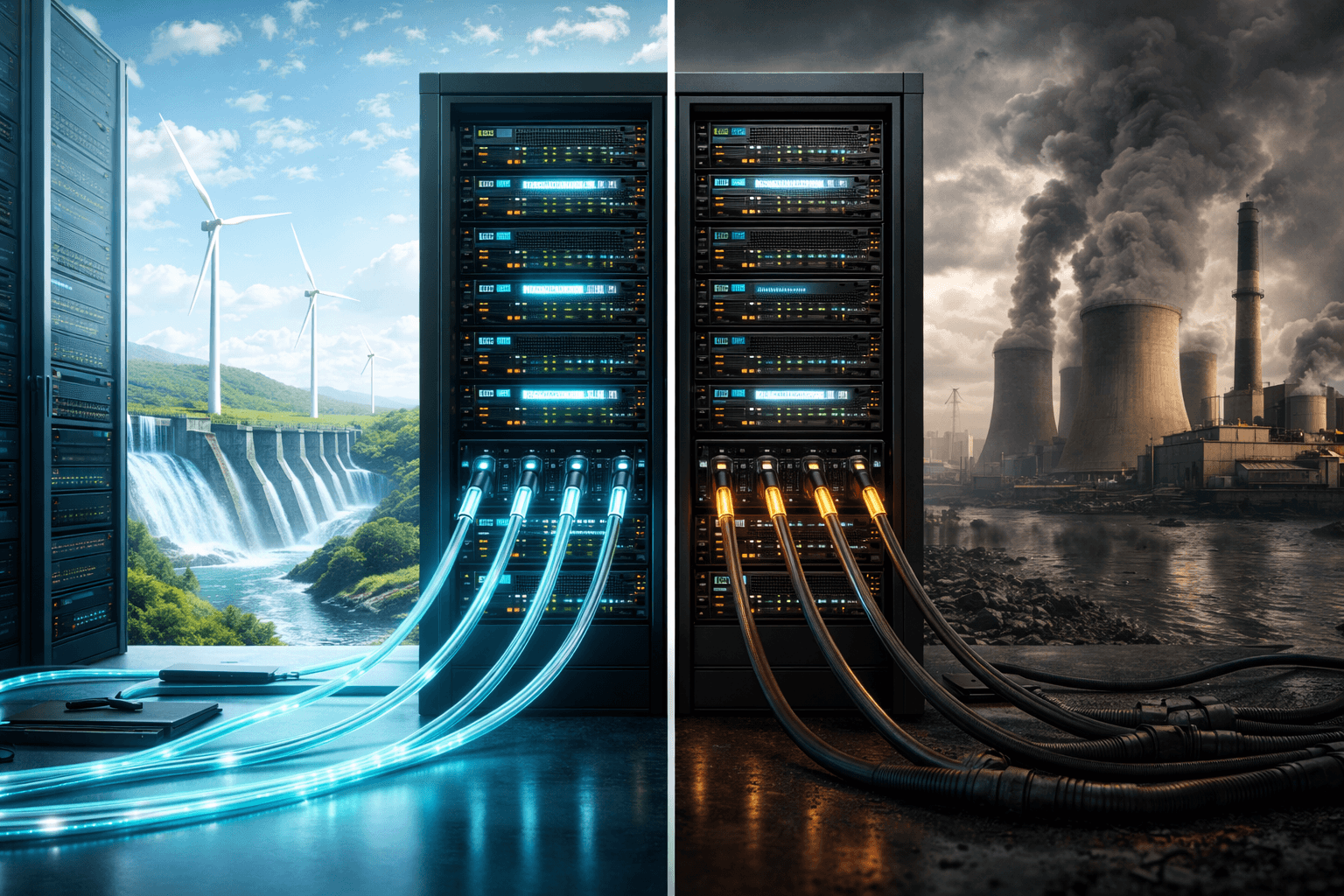

Lassen Sie uns ein kurzes, aufrüttelndes Gedankenexperiment wagen. Stellen Sie sich vor, Sie kaufen das aerodynamischste, teuerste und energieeffizienteste Elektroauto auf dem gesamten Markt. Sie kontrollieren den Reifendruck geradezu obsessiv, fahren extrem vorausschauend und verbannen jeden unnötigen Ballast aus dem Kofferraum. Doch zum Aufladen der sündhaft teuren Hightech-Batterie schließen Sie den Wagen jeden Abend an einen ratternden, rußenden Dieselgenerator in Ihrem Vorgarten an. Ergibt das für Sie irgendeinen Sinn? Wohl kaum. Ein völlig absurdes Szenario, nicht wahr?

Genau diesen eklatanten Widerspruch leben wir jedoch täglich in der modernen Softwareentwicklung. Wir feilen besessen an unseren komplexen Algorithmen, minimieren Ladezeiten durch ausgeklügelte Webpacks und komprimieren Bilder geradezu schmerzhaft bis auf das letzte Byte. Aber dann hosten wir unsere architektonischen Meisterwerke leichtfertig in Regionen, deren Stromnetz primär von dreckigen Kohlekraftwerken gespeist wird. Ein fataler Irrtum!

Spielt es also wirklich eine Rolle, ob ich bei meinem Cloud-Anbieter im Dropdown-Menü "eu-central-1" (Frankfurt) oder "eu-north-1" (Stockholm) auswähle? Die Antwort lautet unmissverständlich: Ja, und zwar gewaltig!

Nehmen wir als Beispiel Sarah, eine Senior-Backend-Entwicklerin aus Berlin. Bei der Bereitstellung einer neuen, ressourcenhungrigen E-Commerce-Plattform klickte sie beim Server-Setup aus purer Gewohnheit auf das geografisch nächstgelegene Rechenzentrum. "Das haben wir immer so gemacht", dachte sie sich, um Ladezeiten gering zu halten. Was sie dabei völlig übersah: Der lokale Strommix eines Landes diktiert die ökologische "Reinheit" ihrer Daten. Hätte Sarah den Server in Skandinavien platziert, würde ihr Code größtenteils von eisigen Flüssen und stetigen Küstenwinden angetrieben – Wasserkraft und Windenergie dominieren dort das Stromnetz. Der CO2-Ausstoß pro verarbeitetem Gigabyte wäre verschwindend gering geblieben. In einem Netz, das wie in vielen mitteleuropäischen oder asiatischen Regionen noch stark von fossilen Brennstoffen abhängig ist, wird hingegen jede noch so genial optimierte Datenbankabfrage zu einem kleinen, unsichtbaren Schornstein, der ungefiltert in die Atmosphäre bläst.

Oft höre ich dann den panischen Aufschrei aus den Reihen der Systemarchitekten: "Aber die Latenz! Unsere verwöhnten Nutzer in München wollen doch keine 30 Millisekunden warten, bis die Antwort aus Schweden eintrifft." Ist das wirklich unser Ernst? Spürt ein menschlicher Anwender eine derart winzige Verzögerung bei einer simplen Webanwendung, während er auf dem Smartphone scrollt? In 99 Prozent der Anwendungsfälle – den automatisierten Finanzhochfrequenzhandel einmal ausgenommen – ist diese Latenz für das menschliche Auge absolut unsichtbar und komplett vernachlässigbar. Wir opfern leichtfertig unseren Planeten auf dem Altar einer nicht spürbaren Mikrosekunde.

Wir müssen dringend den Mut aufbringen, solche festgefahrenen Dogmen und Bequemlichkeiten schonungslos zu hinterfragen. "Green Coding" bedeutet eben nicht nur, den geschriebenen Code selbst zu verschlanken. Es zwingt uns, das gesamte digitale Ökosystem kritisch zu durchleuchten und Geografie als festen, unverrückbaren Bestandteil unserer Systemarchitektur zu begreifen. Ein einfacher, bewusster Klick im Cloud-Dashboard kann den Fußabdruck Ihrer Applikation über Nacht um bis zu 70 Prozent reduzieren. Und das, ohne dass Sie auch nur eine einzige Zeile Ihres Quellcodes umschreiben müssen!

Im nächsten Teil widmen wir uns den heimlichen, gefährlichen Stromfressern unserer Infrastruktur und klären die brennende Frage, wie man die gefürchteten "Zombie-Server" aufspürt und endgültig zur Strecke bringt.

Die Geister, die wir riefen: Das heimliche Leben der Zombie-Server

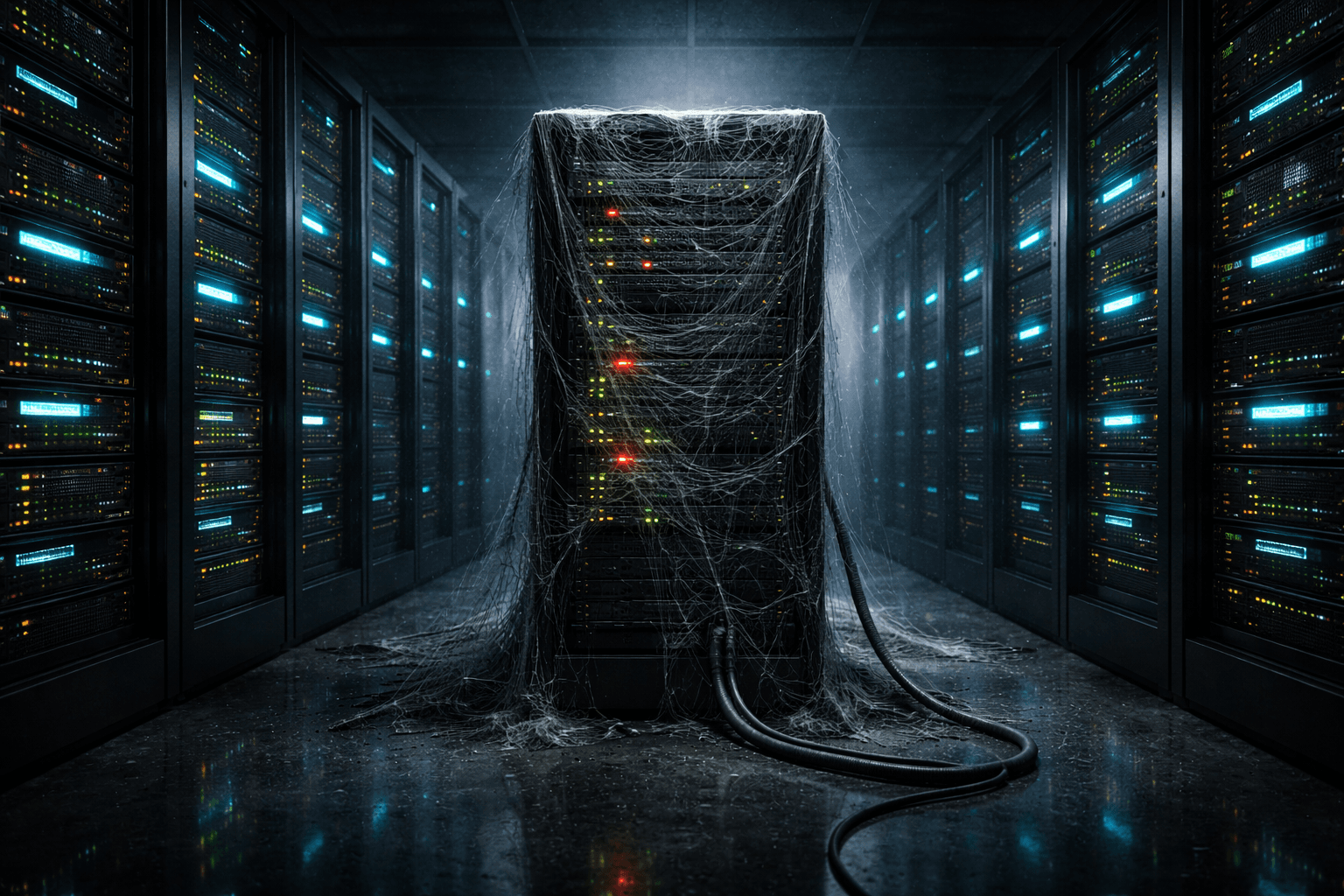

Stellen Sie sich für einen Moment ein gewaltiges, hochmodernes Bürogebäude vor. Es ist drei Uhr nachts. In hunderten Räumen brennt grelles Licht, die Klimaanlage summt ununterbrochen auf Hochtouren, Kaffeemaschinen brühen literweise frischen Kaffee, und Heizkörper strahlen wohlige Wärme ab. Doch wenn Sie durch die verlassenen Flure streifen, entdecken Sie eine absurde Wahrheit: Kein einziger Mitarbeiter ist im Haus. Das Gebäude ist seit Jahren menschenleer. Welcher vernünftige Geschäftsführer, fragen Sie sich jetzt zu Recht, würde eine derart groteske Ressourcenverschwendung auch nur einen Tag lang tolerieren?

Niemand. Doch genau diese surreale Szenerie spielt sich in diesem exakten Moment in den digitalen Kellergewölben unzähliger Unternehmen ab. Wir sprechen von der stillen, heimtückischen und erschreckend realen Plage unserer Zeit: den sogenannten „Zombie-Servern“.

In der Fachsprache werden sie oft als "comatose servers" bezeichnet. Es sind physische oder virtuelle Maschinen, die ununterbrochen laufen, wertvollen Strom aus dem Netz saugen und enorme Mengen an Abwärme produzieren, aber absolut keine nützliche Arbeit mehr verrichten. Sie sind die Untoten der IT-Infrastruktur. Sie verarbeiten keine Nutzeranfragen, berechnen keine Algorithmen und speichern keine relevanten Daten mehr. Sie existieren nur noch, um zu existieren.

Wie entstehen diese digitalen Zombies? Die bittere Wahrheit ist: Meistens durch schlichte menschliche Vergesslichkeit, gepaart mit hastigen Unternehmensprozessen. Ein ehrgeiziges Entwicklerteam richtet an einem Freitagnachmittag rasch eine komplexe Testumgebung in der AWS-Cloud ein, um einen neuen Microservice zu erproben. Das Projekt wird Wochen später abrupt gestoppt, das Team auf andere Aufgaben verteilt – doch niemand drückt den entscheidenden roten Knopf: "Terminate Instance". Oder ein veraltetes Legacy-Backend wird durch ein glänzendes neues System abgelöst. Zur vermeintlichen Sicherheit lässt man die alte Maschine „noch ein paar Wochen mitlaufen, falls etwas schiefgeht“. Aus diesen Wochen werden Monate. Aus Monaten werden Jahre. Der Server rattert stoisch weiter im Leerlauf, gefangen in einer endlosen Warteschleife auf Anfragen, die niemals eintreffen werden.

Warum fällt dieser Wahnsinn niemandem auf? Die Antwort liegt in den tiefen Gräben unserer Firmenstrukturen. IT-Abteilungen arbeiten häufig in stark isolierten Silos. Die Software-Entwickler fokussieren sich auf neuen, brillanten Code. Die Operations-Teams kämpfen einen täglichen Abwehrkampf, um die bestehenden Systeme am Leben zu halten. Und die Buchhaltung? Die nickt die monatlichen, oft hunderte Seiten langen Cloud-Rechnungen zähneknirschend ab. Das toxische Mantra der Branche – „Never touch a running system“ – hat sich verselbstständigt. Die panische Angst davor, versehentlich einen geschäftskritischen Prozess lahmzulegen, ist weitaus größer als der Wunsch nach ökologischer und ökonomischer Effizienz. Niemand will derjenige sein, der den Stecker zieht.

Doch die Konsequenzen dieser kollektiven Wegschau-Mentalität sind verheerend. Studien renommierter Analysten schätzen, dass bis zu 30 Prozent aller weltweit aktiven Server solche Zombies sind. Eine unfassbare Zahl! Jeder dieser comatösen Server verlangt nicht nur stetig nach elektrischer Energie für den eigenen Betrieb, sondern belastet zusätzlich die gigantischen, stromfressenden Kühlsysteme der Rechenzentren. Es ist eine doppelte, toxische Verschwendung. Letztendlich zahlt unser Planet die Zeche in Form von Millionen Tonnen nutzloser, völlig vermeidbarer CO2-Emissionen.

Green Coding bedeutet an dieser Stelle vor allem eines: Mut zur radikalen Inventur! Wir benötigen automatisierte, intelligente Monitoring-Tools, die gnadenlos Alarm schlagen, wenn die CPU-Auslastung einer Instanz über Monate hinweg bei unter drei Prozent vor sich hin dümpelt. Wir müssen das proaktive, angstfreie Abschalten trainieren. Ein sauber dokumentierter, exzellent getesteter Infrastruktur-Code (Infrastructure as Code) erlaubt es uns heute, komplexe Systeme bei Bedarf innerhalb von Minuten aus dem Nichts neu hochzufahren. Es gibt im Jahr 2026 schlichtweg keine technologische Rechtfertigung mehr dafür, Server "auf Verdacht" im Leerlauf brennen zu lassen. Bevor wir uns in den nächsten Iterationen an die feingranulare Optimierung von Datenbankabfragen machen, müssen wir erst einmal den digitalen Müll rigoros vor die Tür setzen.

Nachdem wir unsere Infrastruktur nun von den Untoten befreit haben, betreten wir im nächsten Teil das architektonische Schlachtfeld: Wir analysieren, warum die Art und Weise, wie wir unsere Webseiten rendern – statisch oder dynamisch – über Sieg oder Niederlage im Kampf um eine grüne Klimabilanz entscheidet.

Architektonische Weichenstellung: Der Kampf der Rendering-Strategien

Warum verbrennen wir eigentlich ununterbrochen Energie für Dinge, die sich streng genommen gar nicht verändern?

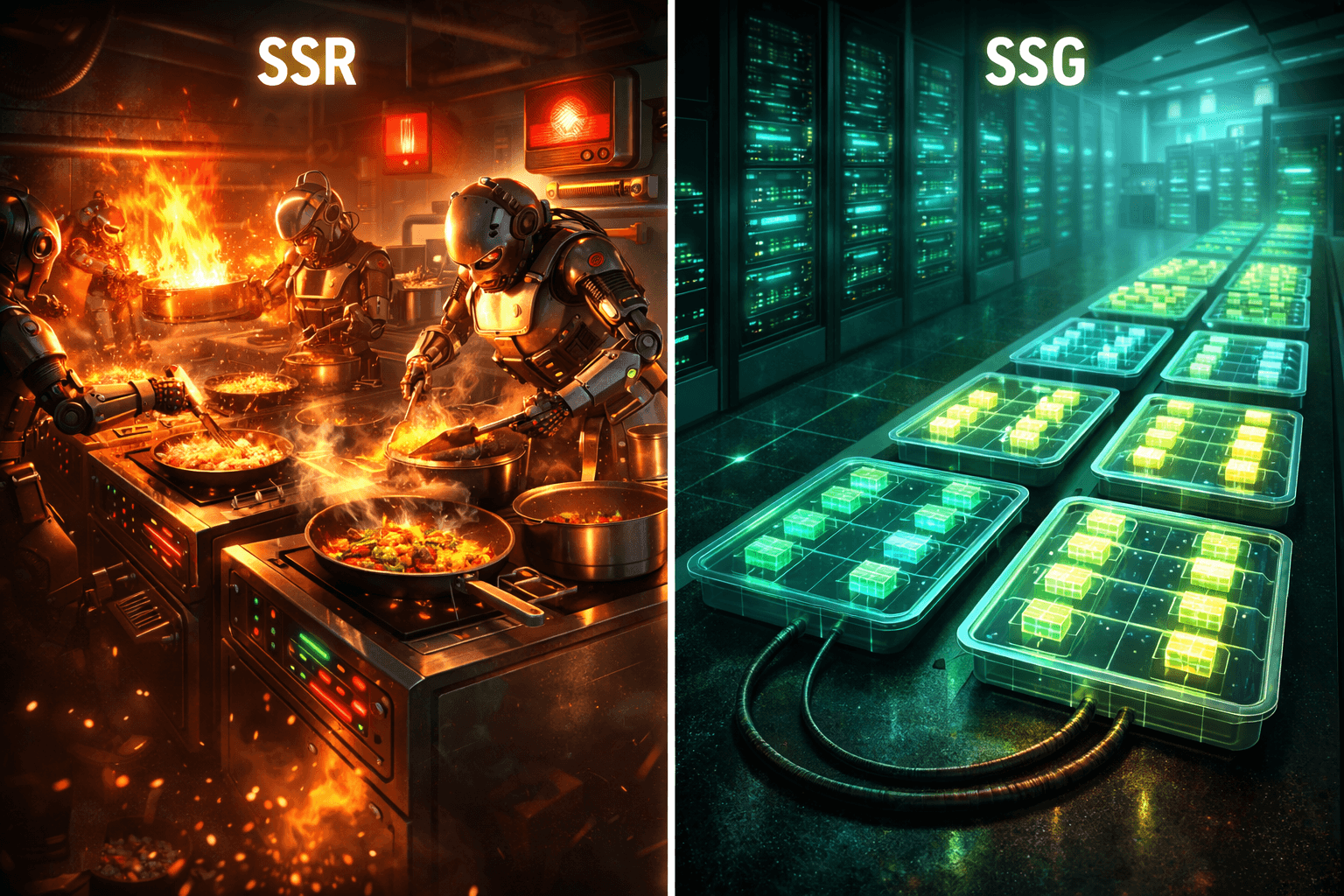

Um diese Frage zu beantworten, müssen wir uns die Art und Weise ansehen, wie moderne Webseiten überhaupt entstehen. Stellen Sie sich vor, Sie leiten ein exklusives, stark besuchtes Restaurant. Ein Gast betritt den Raum, setzt sich und bestellt den "Klassiker des Hauses". Ihr Chefkoch eilt in die Küche, holt frische Zutaten aus dem Kühlschrank, schnippelt das Gemüse, brät das Fleisch auf den Punkt, richtet den Teller kunstvoll an und serviert das Gericht. Zehn Sekunden später betritt der nächste Gast das Lokal und bestellt exakt dasselbe. Wieder rennt der Koch los, wieder brät er, wieder richtet er an. Wenn zehntausend Menschen das identische Menü wollen, kocht Ihr Team zehntausendmal komplett von vorn.

Klingt nach einem unglaublichen, fast schon bizarren Aufwand, oder? Doch genau so – mit dieser atemberaubenden Ineffizienz – arbeitet das klassische Server-Side Rendering (SSR).

Beim traditionellen SSR wird für jeden einzelnen Seitenaufruf eines Nutzers die komplette Maschinerie im Backend angeworfen. Das Framework orchestriert die Anfrage, der Server kontaktiert die Datenbank, holt sich die Datenpakete, rendert das HTML-Dokument in Echtzeit zusammen und schickt es erst dann über das Netzwerk an den Browser. Wenn ein millionenfach gelesener Blog-Artikel oder die Startseite Ihres Unternehmens aufgerufen wird, deren Text sich seit drei Wochen nicht geändert hat, führt Ihr Server dennoch für jeden einzelnen Klick diesen energiehungrigen Tanz auf. Die CPUs glühen, der Stromzähler rotiert. Wozu?

Hier betritt ein wahrer Held des Green Codings die Bühne: die Static Site Generation (SSG), gepaart mit intelligenten Content Delivery Networks (CDNs).

Um bei unserer Restaurant-Analogie zu bleiben: SSG ist das perfekt vorbereitete Hochzeitsbuffet. Der Koch bereitet die Speisen ein einziges Mal in Ruhe vor, bevor die Gäste überhaupt eintreffen. Wenn der Hunger kommt, bedienen sich hunderte Menschen blitzschnell und ohne jegliche Wartezeit selbst. Übertragen auf unsere Architektur bedeutet das: Die Webseite wird einmalig beim Deployment (Build-Prozess) generiert. Das fertige, unveränderliche HTML-Dokument wird dann auf Servern weltweit verteilt (CDN). Wenn nun ein Nutzer aus Tokio oder Berlin die Seite anfordert, bekommt er sofort das fertige Dokument aus dem nächstgelegenen Zwischenspeicher geliefert. Der Ursprungsserver? Der schläft derweil tief und fest und verbraucht nahezu null Watt.

Ist das nicht eine herrliche, saubere Lösung? Natürlich gibt es einen Haken. Was passiert, wenn sich Preise im Online-Shop sekündlich ändern oder personalisierte Nutzerdaten angezeigt werden müssen? Hier stößt reine Statik an ihre Grenzen. Wir können nicht für jeden eingeloggten User das gesamte Internet neu "bauen".

Aber müssen wir deshalb gleich kapitulieren und zum stromfressenden SSR zurückkehren? Keineswegs. Die moderne Webentwicklung bietet uns brillante Kompromisse wie Incremental Static Regeneration (ISR). Dabei bleiben die Seiten statisch und ressourcenschonend, erneuern sich aber elegant im Hintergrund selbst, sobald alte Daten abgelaufen sind. Es ist ein maßgeschneiderter Hybrid.

Die bewusste Entscheidung, welche Seite dynamisch gerendert werden muss und welche statisch ausgeliefert werden kann, ist keine reine Performance-Frage mehr. Sie ist gelebter Umweltschutz. Jede Datenbankabfrage, die wir durch schlaues Vorab-Rendern vermeiden, ist eine kleine, gewonnene Schlacht gegen den Klimawandel.

Im nächsten Teil werfen wir einen schonungslosen Blick auf unseren Code selbst. Wir werden sezieren, wie aufgeblähte Frameworks und unachtsame Schleifen die Prozessoren unnötig quälen und wie wir durch radikalen Minimalismus unsere Applikationen auf Diät setzen.

Code-Diät: Warum Minimalismus im Backend das Klima schont

Haben Sie sich schon einmal dabei ertappt, wie Sie eine riesige Software-Bibliothek importiert haben, nur um eine einzige, winzige Funktion daraus zu nutzen?

Nehmen wir unser fiktives Beispiel von Julian, einem engagierten Backend-Entwickler. Julian brauchte für ein neues Dashboard lediglich eine Funktion, um ein Datum im europäischen Format auszugeben. Anstatt drei einfache Zeilen Code selbst zu schreiben, importierte er hastig eine beliebte, 2 Megabyte große Open-Source-Bibliothek. "Speicherplatz und Bandbreite kosten heute doch fast nichts mehr", dachte er sich schulterzuckend und schob das Ticket auf "Done".

Diese Denkweise ist eine gefährliche, leider branchenweit verbreitete Illusion. Speicherplatz und Bandbreite mögen auf der monatlichen AWS-Rechnung trivial erscheinen, aber die physische Übertragung und die ständige Verarbeitung dieser massiven Datenmengen fressen echten Strom. Wir haben uns über das letzte Jahrzehnt eine fatale architektonische Bequemlichkeit angewöhnt. Wir bauen unsere digitalen Applikationen mittlerweile wie ein Reisender, der für einen kurzen Wochenendtrip nach Paris seinen kompletten Kleiderschrank in einen schweren Lkw verlädt – nur für den überaus unwahrscheinlichen Fall, dass er plötzlich einen Smoking oder einen Tiefseetaucheranzug benötigt. Das ist nicht nur unpraktisch, es ist ökologischer Irrsinn.

Das zentrale Stichwort in diesem Kampf gegen den digitalen Speck lautet algorithmische Effizienz. Im Informatikstudium pauken wir alle die sogenannte Big-O-Notation. Ein Algorithmus mit einer Komplexität von $O(n^2)$ mag bei hundert Test-Datensätzen auf dem extrem leistungsstarken lokalen Laptop des Entwicklers noch rasend schnell und flüssig wirken. Aber was passiert in der realen Produktionsumgebung, wenn die Datenbank plötzlich auf eine Million Einträge anwächst? Die unbedacht verschachtelte Schleife zwingt die Server-CPU unweigerlich in die Knie. Der Lüfter im Rechenzentrum heult auf, die Kühlanlage muss massiv gegensteuern. Der Energieverbrauch steigt buchstäblich exponentiell an. Jede unnötige Iteration, jedes ineffiziente Sortierverfahren und jeder schlecht geschriebene Regex-Ausdruck ist eine direkte, messbare Belastung für das Stromnetz.

Muss es also wirklich für jede simple Datenbankabfrage ein wuchtiges Object-Relational Mapping (ORM) Tool sein? Solche Frameworks sind unbestritten komfortabel, doch sie generieren im Hintergrund oft ein schauderhaftes Labyrinth aus dutzenden ineffizienten Joins. Manchmal reicht ein maßgeschneiderter, sauber handgeschriebener SQL-Befehl völlig aus, um die Ausführungszeit – und damit den Energieverbrauch – auf einen Bruchteil zu reduzieren.

Green Coding verlangt von uns eine ehrliche Rückbesinnung auf das eigentliche, pure Handwerk der Softwareentwicklung. Code-Minimalismus ist längst nicht mehr nur eine ästhetische Tugend für Puristen, er ist hart praktizierter Umweltschutz. Ein schlankes, intelligentes Backend verarbeitet deutlich mehr Nutzeranfragen pro Sekunde mit wesentlich weniger Hardware. Es erlaubt uns, Server aktiv herunterzuskalieren. Und als erfreulicher Nebeneffekt macht dieser Minimalismus die gesamte Architektur robuster, lesbarer und deutlich fehlerresistenter.

Wir müssen lernen, unseren Code auf Diät zu setzen. Jedes Byte zählt. Nachdem wir unsere Algorithmen nun verschlankt haben, stoßen wir auf das nächste massive Problemfeld: unsere Daten. Im nächsten Teil widmen wir uns der Frage, wie viel digitalen Müll wir eigentlich täglich anhäufen und warum dieser "digitale Messie-Wahnsinn" unser Klima bedroht.

Digitale Messies: Die versteckte Klimaschuld unserer Datenbanken

Wann haben Sie eigentlich das letzte Mal Ihren Dachboden oder Ihren Keller so richtig gründlich aufgeräumt? Wahrscheinlich horten Sie dort – genau wie die meisten von uns – alte Kartons voller Erinnerungsstücke, ausgemusterte Kleidung und kaputte Elektrogeräte, die Sie "vielleicht irgendwann mal wieder brauchen könnten". In der physischen Welt kostet uns dieses Verhalten lediglich ein wenig Platz und ab und zu ein schlechtes Gewissen. Doch was passiert, wenn wir dieses menschliche Sammelverhalten in unsere Softwarearchitektur übertragen?

Willkommen im Zeitalter der "Dark Data".

Als Dark Data bezeichnen wir all jene riesigen Datenberge, die Unternehmen täglich wie besessen sammeln, verarbeiten und auf teuren Servern abspeichern, danach aber niemals wieder ansehen oder für irgendeinen sinnvollen Geschäftszweck nutzen. Es sind die verwaisten Log-Files von vor fünf Jahren. Es sind die hochauflösenden, niemals komprimierten Originalbilder von Produkten, die längst nicht mehr im Sortiment sind. Es sind die redundanten Backups von Testumgebungen, die niemand mehr kennt. Wir sind zu einer Spezies von digitalen Messies mutiert.

"Speicherplatz kostet heute doch fast nichts mehr", lautet das gefährlichste Mantra der modernen IT-Welt. Finanziell betrachtet mag ein Terabyte bei Amazon S3 lächerlich günstig erscheinen. Ökologisch gesehen ist dieser Speicherplatz jedoch sündhaft teuer! Denn anders als der alte staubige Karton auf Ihrem Dachboden, ruhen digitale Daten nicht einfach friedlich vor sich hin. Sie liegen auf physischen Festplatten (HDDs) oder SSDs, die rund um die Uhr am Stromnetz hängen. Sie werden gespiegelt, indiziert und durch gigantische Kühlanlagen vor dem Hitzetod bewahrt. Jedes ungenutzte Terabyte an Dark Data ist ein parasitärer Verbraucher, der konstant und völlig sinnlos Ressourcen aus dem Stromnetz saugt.

Hier setzt das Green Coding an und fordert eine radikale Umkehr: Wir brauchen ein knallhartes Verfallsdatum für Daten.

Stellen Sie sich vor, Ihr Backend-Code wäre so intelligent konzipiert, dass er nicht nur Daten in die Datenbank schreibt, sondern sich auch proaktiv um deren umweltfreundliche Entsorgung kümmert. Eine automatisierte Data-Retention-Policy, die temporäre Tabellen, alte Session-Tokens und überflüssige Tracking-Ereignisse nach exakt 30 Tagen unwiderruflich aus dem System brennt. Weniger Daten bedeuten kleinere Indizes. Kleinere Indizes bedeuten schnellere Suchanfragen. Und schnellere Suchanfragen bedeuten signifikant weniger Rechenzeit und CPU-Last für den Server.

Doch was ist mit den Daten, die wir tatsächlich ständig brauchen? Hier lautet das magische Zauberwort: Caching.

Lassen Sie uns zu einer einfachen Analogie greifen. Wenn Sie in einer Bibliothek arbeiten und alle fünf Minuten jemand nach demselben Lexikon fragt, rennen Sie dann jedes Mal in den dritten Stock, suchen das Buch im Regal, bringen es nach unten, nur um es danach direkt wieder hochzubringen? Nein, Sie legen es sich griffbereit auf Ihren Schreibtisch. Genau das macht ein gut konfigurierter Cache (wie Redis oder Memcached). Jedes Mal, wenn Ihr Backend für eine simple, oft wiederkehrende Information die Datenbank anfunkt – die Festplatten rotieren lässt, komplexe Joins ausführt und den Arbeitsspeicher belastet –, anstatt die Antwort direkt aus dem blitzschnellen Cache zu servieren, verschwenden Sie Energie.

Eine unnötige Datenbankabfrage ist ein Verbrechen an der Effizienz. Wenn wir unsere Architektur so umbauen, dass wir Daten intelligenter ablegen, schneller finden und rigoroser löschen, lindern wir die Last auf unseren Rechenzentren enorm. Im vorletzten Teil unserer Serie werden wir uns ansehen, wie diese Daten überhaupt zu unseren Nutzern gelangen und warum "fette" Netzwerklasten die versteckten CO2-Treiber unserer mobilen Endgeräte sind.

Der unsichtbare Transportweg: Warum "fette" Datenpakete das Klima aufheizen

Haben Sie sich jemals ernsthaft Gedanken darüber gemacht, was exakt passiert, nachdem Ihr Server die Daten auf die Reise schickt? Wir neigen in unserer schnelllebigen Welt dazu, das Internet als eine Art magisches Beamen zu betrachten. Ein Klick auf dem Smartphone, und puff – die Website ist einfach da.

Doch die physikalische Realität sieht völlig anders aus. Jedes einzelne Byte muss durch ein globales, massives Netzwerk aus dicken Glasfaserkabeln, tiefen Untersee-Leitungen, ratternden Routern und sendestarken Mobilfunkmasten gepresst werden. Und jede einzelne dieser Zwischenstationen benötigt Strom. Jede Menge Strom.

Stellen Sie sich vor, Sie möchten einem Freund im Ausland ein kurzes, simples Rezept für Pfannkuchen schicken. Anstatt die Zutaten einfach auf eine handliche Postkarte zu schreiben, verpacken Sie Ihre gesamte, hunderte Kilo schwere Kücheneinrichtung samt Kochbüchern in einen riesigen Seecontainer und lassen diesen per Frachtschiff um die halbe Welt transportieren. "Er kann sich das Rezept ja dann selbst aus dem richtigen Buch heraussuchen", denken Sie sich. Das ist völlig absurd, oder? Niemand würde in der physischen Welt so handeln.

Doch exakt so verhalten wir uns heute erschreckend oft beim Webdesign. Wir zwingen die Smartphones unserer Nutzer, hochauflösende 4-Megabyte-Bilder, gigantische, ungenutzte JavaScript-Bibliotheken und automatisch abspielende Hintergrundvideos herunterzuladen – nur um einen einfachen Textartikel anzuzeigen. Wir versenden digitale Seecontainer, wo eine simple Postkarte völlig ausgereicht hätte.

Besonders dramatisch wird dieser digitale Überfluss bei der mobilen Datennutzung. Wissen Sie eigentlich, wie extrem energiehungrig das moderne Mobilfunknetz ist? Ein Megabyte über eine 4G- oder 5G-Verbindung zu übertragen, verbraucht ein Vielfaches der Energie einer herkömmlichen, kabelgebundenen WLAN-Verbindung. Hinzu kommt die fatale Auswirkung auf den Endnutzer: Ein heillos überladenes Frontend zwingt den winzigen Prozessor des Smartphones zur absoluten Schwerstarbeit. Das Gerät wird in den Händen des Nutzers spürbar heiß, der Akku entleert sich rasend schnell, und das Smartphone muss Stunden früher wieder an die rettende Steckdose. Wir lagern unsere eigene architektonische Ineffizienz gnadenlos auf unsere Nutzer und deren Stromrechnung aus.

Hier wird die konsequente Frontend- und Payload-Optimierung zum direkten, messbaren Klimaschutz. Nehmen wir das fiktive Beispiel von Lena, einer talentierten Frontend-Entwicklerin bei einem großen Magazin. Anstatt Bilder einfach im veralteten, schweren JPEG-Format hochzuladen, implementierte sie moderne, hochkomprimierte Formate wie WebP oder AVIF. Sie führte kompromissloses "Lazy Loading" ein, sodass Bilder erst in dem exakten Moment vom Server geladen werden, wenn der Nutzer auch tatsächlich in diesen Bereich scrollt. Die Auswirkungen dieses scheinbar kleinen Eingriffs waren phänomenal: Die Ladezeit halbierte sich, die Absprungrate der frustrierten Leser sank drastisch, und ganz nebenbei reduzierte sie den Traffic und damit den CO2-Ausstoß der Website um unglaubliche 40 Prozent.

Es ist eine absolute Win-win-Situation. Ein rasantes, schlankes Web ist nicht nur ein Segen für die zunehmend ungeduldigen Nutzer, sondern auch eine immense Wohltat für unsere global überlasteten Stromnetze. Komprimierung, die Minifizierung von Code und der bewusste Verzicht auf kosmetischen, aber funktionslosen Ballast sind die stärksten Waffen in unserem Arsenal.

Wir haben nun Server-Standorte optimiert, Datenbanken aufgeräumt und den Datenverkehr drastisch verschlankt. Aber woher wissen wir am Ende des Tages eigentlich, ob unsere Bemühungen wirklich Früchte tragen? Im achten und finalen Teil unserer Serie zeigen wir Ihnen, wie Sie den CO2-Fußabdruck Ihres Codes präzise messen können und wie Sie Green Coding dauerhaft in der DNA Ihrer Unternehmenskultur verankern.

Das Unsichtbare messbar machen: Der Weg zur grünen Unternehmenskultur

Haben Sie schon einmal ernsthaft versucht, für einen Marathon zu trainieren oder Gewicht zu verlieren, sich aber gleichzeitig strikt geweigert, jemals eine Stoppuhr zu benutzen oder auf eine Waage zu steigen? Wahrscheinlich würden Sie schnell frustriert aufgeben. Das bloße Gefühl, "irgendwie schneller" oder "irgendwie leichter" geworden zu sein, reicht für echten Fortschritt nicht aus.

Genau diesem fundamentalen Problem stehen viele Software-Teams gegenüber, wenn sie sich dem Thema Green Coding widmen. Wir können Datenbanken aufräumen, Server umziehen und den Traffic komprimieren – aber wenn wir die resultierenden Einsparungen nicht in harten, unbestechlichen Zahlen messen können, tappen wir weiterhin völlig im Dunkeln. Wir können nur optimieren, was wir auch quantifizieren können.

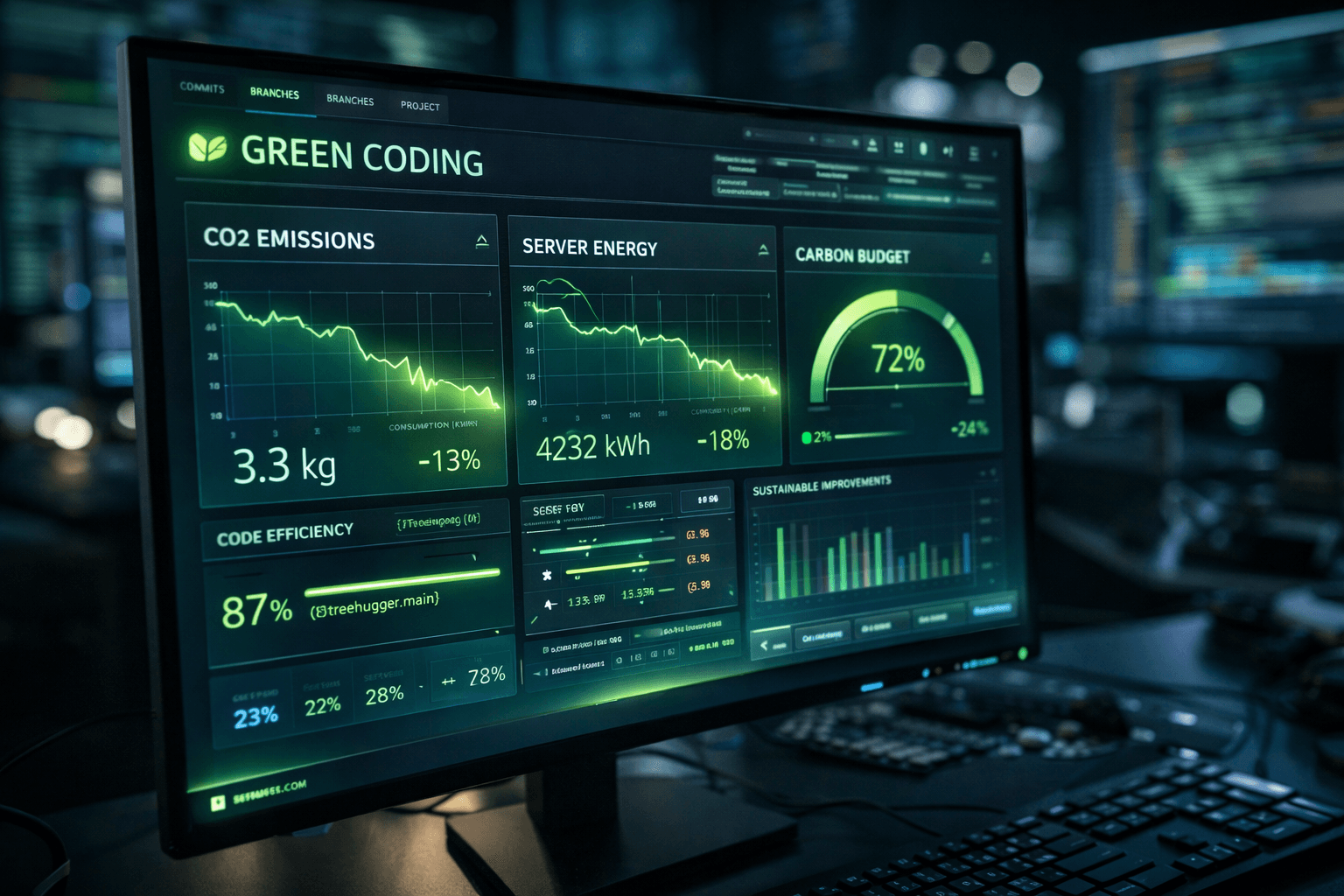

Zum Glück hat die Branche in den letzten Jahren enorm aufgeholt. Wir sind nicht mehr auf grobe Schätzungen angewiesen. Die Open-Source-Community und diverse Non-Profit-Organisationen haben ein beeindruckendes Arsenal an präzisen Messwerkzeugen geschmiedet. Nehmen wir zum Beispiel CO2.js von der Green Web Foundation. Diese geniale, kleine JavaScript-Bibliothek ermöglicht es Entwicklern, die Emissionen jedes übertragenen Datenpakets direkt in der eigenen Applikation zu schätzen. Für das rechenintensive Backend oder das Training von Machine-Learning-Modellen existieren mächtige Tools wie CodeCarbon. Solche Frameworks klinken sich tief in Ihre Infrastruktur ein, lesen den tatsächlichen, hardwarebasierten Energieverbrauch von CPU und GPU in Echtzeit ab und berechnen daraus – gekoppelt mit dem lokalen Strommix des Rechenzentrums – den exakten ökologischen Fußabdruck Ihres Codes. Selbst die großen Cloud-Provider wie AWS, Azure und Google Cloud bieten inzwischen integrierte Dashboards an, die Ihre monatlichen Emissionen detailliert aufschlüsseln.

Doch machen wir uns nichts vor: Das beste und teuerste Monitoring-Tool der Welt nützt absolut nichts, wenn die Unternehmenskultur nicht stimmt.

Green Coding darf kein isoliertes Hobbyprotjekt eines einzelnen, idealistischen Entwicklers sein, der nach Feierabend heimlich Codezeilen optimiert. Es muss tief in die DNA des gesamten Unternehmens übergehen. Stellen Sie sich vor, Nachhaltigkeit wäre kein nachträgliches "Nice-to-have", sondern ein hartes, unumstößliches Akzeptanzkriterium in Ihrer CI/CD-Pipeline.

Ein mutiges Team bei einem mittelständischen SaaS-Anbieter hat genau das kürzlich gewagt: Sie führten ein striktes "Carbon Budget" für ihre Entwicklungs-Sprints ein. Das System war gnadenlos. Wenn ein neuer Pull Request (PR) die durchschnittliche CPU-Last oder den Speicherbedarf des Backends um mehr als fünf Prozent nach oben trieb, schlug die automatisierte Pipeline sofort rot alarm. Der Code durfte schlichtweg nicht in die Produktion gehen, bevor die Ineffizienz behoben oder stichhaltig vor dem Lead-Architekten gerechtfertigt wurde. Was anfänglich zu heftigem Zähneknirschen führte, entpuppte sich bald als brillanter Motivator. Plötzlich begannen die Entwickler, freiwillig und leidenschaftlich über ressourcenschonende Algorithmen zu diskutieren. Es wurde zu einem sportlichen, intellektuell anspruchsvollen Wettbewerb, wer die performanteste und gleichzeitig "grünste" Funktion schreiben konnte.

Wir sind am Ende unserer achtteiligen Reise angekommen. Wir haben die physischen Standorte der Cloud erkundet, dunkle Datenkeller ausgemistet, Zombie-Server erlegt und unsere Algorithmen auf eine strenge Diät gesetzt.

Erinnern Sie sich noch an die alte, hitzige Glühbirne auf Ihrem Schreibtisch aus unserem allerersten Teil? Jedes Mal, wenn Sie in Zukunft eine Zeile Code schreiben, eine riesige Bibliothek importieren oder einen Server hochfahren, denken Sie an dieses grelle Aufblitzen. Sie als Entwickler, Architekt oder IT-Entscheider haben die direkte Macht in Ihren Händen. Sie entscheiden jeden Tag aufs Neue, wie viel Energie unsere digitale Welt verbrennt. Code ist niemals nur abstrakte Logik. Code ist gebündelte, physische Energie.

Lassen Sie uns diese Energie weise, respektvoll und nachhaltig nutzen. Das Klima wartet nicht auf das nächste Release-Update.

Zusammenfassung: Die 8 Säulen des Green Codings

Die Artikelserie "Sustainable Web Design: Wie effizienter Code das Klima schützt" beleuchtet die oft übersehene physische und ökologische Realität unserer digitalen Welt. Jede Codezeile, jede Datenbankabfrage und jedes übertragene Datenpaket verbraucht echte elektrische Energie. Da die IT-Branche mittlerweile einen globalen CO2-Fußabdruck ähnlich dem der Luftfahrtindustrie aufweist, ist Green Coding vom Nischenthema zur absoluten Notwendigkeit geworden.

Um den Energieverbrauch von Backend-Systemen und Webapplikationen signifikant zu senken, müssen Entwickler und IT-Entscheider an mehreren Hebeln ansetzen:

Server-Standort: Die Wahl von Rechenzentren in Regionen mit einem hohen Anteil an erneuerbaren Energien reduziert die Emissionen sofort.

Zombie-Server: Das konsequente Aufspüren und Abschalten von ungenutzten Server-Instanzen verhindert massive Energieverschwendung im Leerlauf.

Rendering-Strategien: Statische Site Generation (SSG) und intelligente Caching-Mechanismen (ISR) sind ressourcenschonender als ständiges Server-Side Rendering (SSR).

Code-Minimalismus: Algorithmische Effizienz und der Verzicht auf überdimensionierte Bibliotheken entlasten die Prozessoren.

Dark Data & Caching: Das Löschen von veralteten Daten und die Nutzung von In-Memory-Caches (wie Redis) verhindern unnötige und energieintensive Festplattenzugriffe.

Payload-Optimierung: Schlanke Datenpakete (moderne Bildformate, Minifizierung) reduzieren den Stromverbrauch bei der Übertragung durch die globalen Netzwerke.

Messbarkeit & Kultur: Nachhaltigkeit muss durch Tools wie CO2.js oder CodeCarbon quantifizierbar gemacht und als festes Qualitätskriterium (Carbon Budget) in die Unternehmenskultur integriert werden.