Ein brillanter Artikel nützt nichts, wenn die Suchmaschine ihn als unstrukturierten Zeichensalat wahrnimmt. In einer Zeit, in der KI-Agenten das Web nach Antworten durchforsten, ist JSON-LD Ihr wichtigster Dolmetscher. Verabschieden Sie sich vom Microdata-Chaos und lernen Sie, wie Sie mit dem TechArticle-Schema, verifizierten Autoren-Daten (E-E-A-T) und Video-"Key Moments" die Suchergebnisse und KI-Antworten von Google dominieren.

Die Quantenphysik des Internets

Erinnern Sie sich an den Moment, als Sie das erste Mal versuchten, einem Kind Quantenphysik zu erklären? Sie suchen nach greifbaren Vergleichen, fuchteln wild mit den Händen und ernten am Ende doch nur einen leeren, fragenden Blick.

Genau so fühlt sich Schema Markup für Google und moderne Sprachmodelle (LLMs) an.

Wir Menschen sind Meister des Kontexts. Wenn wir eine Webseite betrachten, auf der oben groß "Tech-News" steht, darunter der Name "Max Mustermann" und ein Datum prangt, wissen wir intuitiv: Das ist ein redaktioneller Artikel. Die große Zahl unten rechts ist vermutlich die Lesezeit, und der rote Button startet ein Video.

Für eine Künstliche Intelligenz oder den Googlebot ist diese Webseite zunächst einmal nur eine endlose, stumme Wüste aus <div>- und <span>-Tags. Es ist eine Kakophonie aus Zeichenketten (Strings), denen jegliche inhaltliche Bedeutung (Semantik) fehlt. Die Maschine sieht den Text, aber sie versteht ihn nicht.

In einer Zeit, in der das Web zunehmend von autonomen Agenten (dem sogenannten "Agentic Web") durchsucht wird, reicht es nicht mehr, Informationen nur hübsch für das menschliche Auge zu formatieren. Wenn wir wollen, dass unsere Technik-Artikel als glänzendes Rich Snippet ganz oben in den Suchergebnissen thronen, als direkte Antwort in ChatGPT zitiert werden oder in einem interaktiven Karussell auftauchen, müssen wir Dolmetscher spielen.

Wir müssen aufhören, in "Strings" zu denken, und anfangen, in "Things" (Entitäten) zu sprechen.

Das Werkzeug unserer Wahl dafür ist Schema.org – ein standardisiertes Vokabular, das von den größten Suchmaschinen der Welt gemeinsam entwickelt wurde. Es ist das Etikettiergerät für das digitale Zeitalter. Anstatt der Maschine einen unbeschrifteten Aktenordner vor die Füße zu werfen und zu hoffen, dass sie den Inhalt errät, kleben wir mit strukturierten Daten ein exaktes, maschinenlesbares Inhaltsverzeichnis darauf.

Wir servieren unsere Inhalte mundgerecht. Und im Jahr 2026 gibt es dafür nur noch einen ernstzunehmenden Standard: JSON-LD.

Der Architektur-Entscheid – Warum Microdata tot ist

Bevor wir in den Code eintauchen, müssen wir eine historische Altlast aus dem Weg räumen. Wenn Sie sich in ältere SEO-Foren verirren, werden Sie oft auf hitzige Debatten über das richtige Format für Schema Markup stoßen. Die beiden Kontrahenten: Microdata und JSON-LD.

Lassen Sie mich das im Jahr 2026 ganz unmissverständlich formulieren: Wer heute noch Microdata für neue Projekte verwendet, baut technische Schulden mit Vorsatz.

Warum bin ich da so strikt? Lassen Sie uns eine Analogie bemühen. Stellen Sie sich vor, Sie bauen einen Motor. Bei Microdata nehmen Sie einen wasserfesten Filzstift und schreiben die Spezifikationen (Drehmoment, Teilenummer) direkt auf jedes einzelne Zahnrad und jedes Ventil. Das funktioniert, solange der Motor stillsteht. Aber sobald Sie etwas austauschen oder die Bauweise verändern müssen, fangen Sie an, mühsam den Filzstift abzukratzen und neu zu schreiben. Microdata zwingt Sie dazu, Ihre strukturierten Daten direkt als Attribute in Ihre bestehenden HTML-Tags (wie <div> oder <span>) zu weben. Das Resultat ist ein unleserlicher, fragiler Code-Brei. Ändert der Frontend-Designer die CSS-Klassenstruktur, zerschießt er oft versehentlich das gesamte Markup.

JSON-LD (JavaScript Object Notation for Linked Data) hingegen ist das saubere Handbuch im Handschuhfach.

Es entkoppelt die Datenstruktur vollständig von der visuellen Präsentation. Sie fügen einen einzigen, sauberen <script type="application/ld+json"> Block in den <head> (oder auch ans Ende) Ihres Dokuments ein. Dieser Block enthält alle Informationen über den Artikel, den Autor und die Bilder in einem maschinenlesbaren JSON-Format.

Die Vorteile sind gigantisch:

Saubere Trennung: Ihr Frontend-Team kann das Layout der Webseite beliebig umbauen, ohne dass die SEO-Abteilung in Panik gerät.

Skalierbarkeit: In CMS-Systemen oder Headless-Architekturen lässt sich ein zentrales JSON-Objekt dynamisch viel einfacher aus einer Datenbank generieren als Hunderte von verstreuten HTML-Attributen.

Der Google-Segen: Google selbst hat bereits vor Jahren offiziell verkündet, dass JSON-LD das empfohlene Format ist. Sprachmodelle und KI-Agenten, die das Web über Protokolle wie MCP (Model Context Protocol) parsen, bevorzugen ebenfalls saubere JSON-Strukturen, da sie diese nativ und ohne fehleranfälliges DOM-Scraping verarbeiten können.

Wir bringen der Maschine das Lesen also nicht bei, indem wir unser Design verschandeln. Wir überreichen ihr stattdessen eine perfekt formatierte Visitenkarte.

Nachdem wir nun das "Wie" geklärt haben, widmen wir uns dem "Was". Im nächsten Schritt sehen wir uns an, wie genau das Markup für einen Tech-Artikel aussehen muss, um in die begehrten News-Carousels zu gelangen.

Der Bauplan – So sieht perfektes JSON-LD aus

Wenn wir einen Fachartikel auf technikermagazin.de veröffentlichen, reicht das generische Article-Schema für Google längst nicht mehr aus. Wir wollen der Suchmaschine und den neuen KI-Agenten zeigen, dass dies ein tiefergehender, technischer Text ist. Deshalb nutzen wir das viel spezifischere TechArticle-Schema.

Stellen Sie sich JSON-LD wie eine extrem penible Zollinhaltserklärung vor. Der Zollbeamte (die KI) macht das Paket (Ihre Webseite) nicht auf, um mühsam zu lesen, was drin ist. Er schaut nur auf den standardisierten Aufkleber. Wenn der Aufkleber fehlt oder unleserlich ist, bleibt das Paket im Lager liegen und wird niemals in den begehrten "Top Stories" Karussells angezeigt.

Hier ist ein Beispiel, wie ein solcher "Aufkleber" für einen unserer Artikel im Jahr 2026 im Quelltext aussieht:

JSON

<script type="application/ld+json">

{

"@context": "https://schema.org",

"@type": "TechArticle",

"headline": "Vanilla JS vs. Frameworks 2026: Zurück zu den Basics",

"description": "Warum natives JavaScript und CSS oft mächtiger sind als React-Wrapper.",

"proficiencyLevel": "Expert",

"dependencies": "Grundkenntnisse in JavaScript und DOM-Manipulation",

"author": {

"@type": "Person",

"name": "Max Mustermann",

"jobTitle": "Senior Software Architect",

"url": "https://technikermagazin.de/autoren/max-mustermann"

},

"publisher": {

"@type": "Organization",

"name": "Technikermagazin",

"logo": {

"@type": "ImageObject",

"url": "https://technikermagazin.de/logo.png"

}

},

"datePublished": "2026-03-03T08:00:00+01:00"

}

</script>

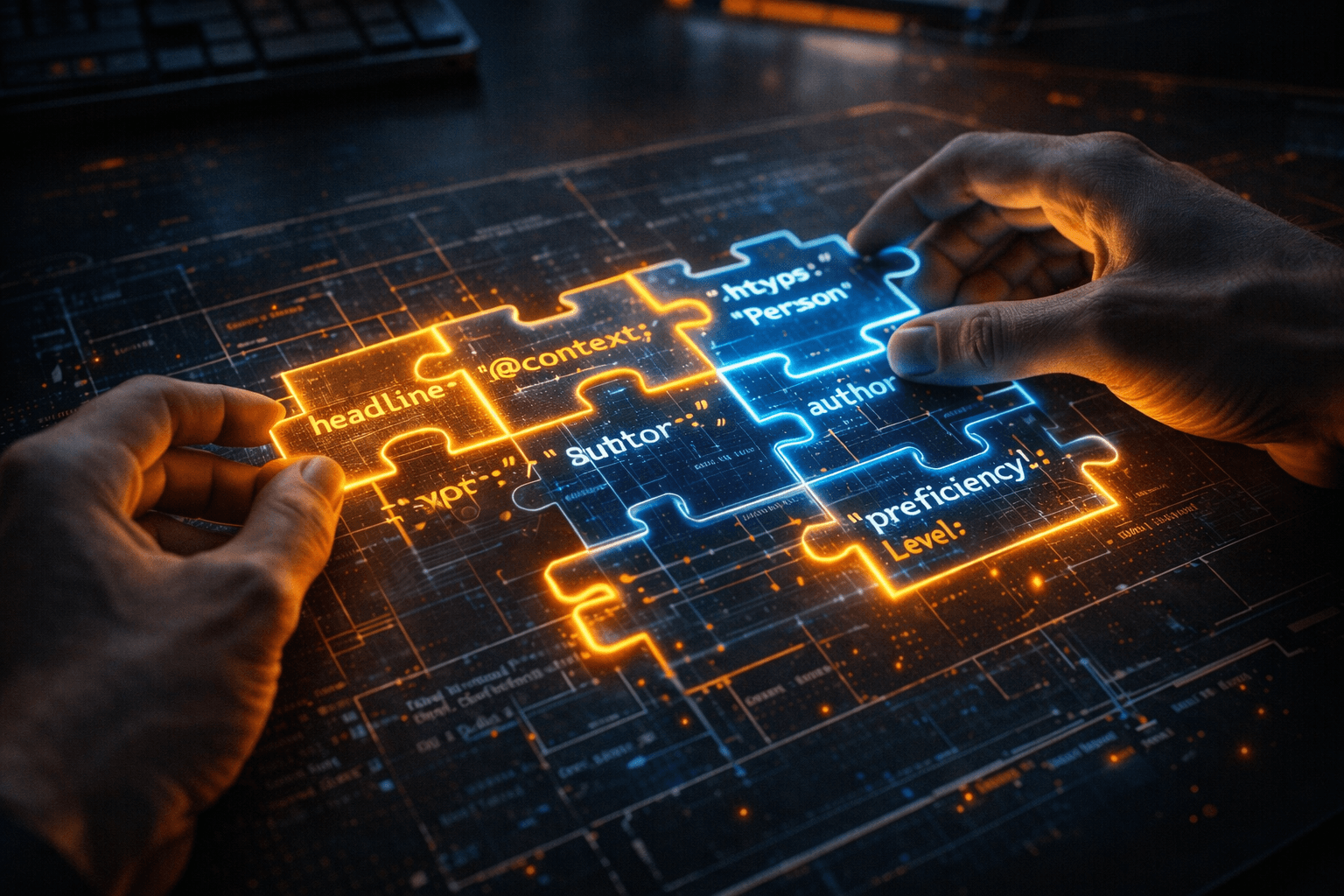

Haben Sie die entscheidenden Details bemerkt? Wir nutzen Felder aus dem TechArticle-Standard wie proficiencyLevel (Expert) und dependencies.

Warum tun wir das? Wenn ein Nutzer einen KI-Assistenten nach "Fortgeschrittenen JavaScript Architektur Tipps" fragt, scannt das LLM (Large Language Model) genau diese Meta-Ebenen. Durch das Wort "Expert" weiß das Modell sofort: "Dieser Artikel ist nichts für Anfänger, er erfordert tiefes Vorwissen und passt exakt zur komplexen Anfrage des Nutzers."

Wir haben der Maschine nicht nur gesagt, dass Text auf der Seite steht. Wir haben ihr die exakte inhaltliche Tiefe, die Zielgruppe und den fachlichen Anspruch diktiert. Ein Code-Schnipsel, der den Unterschied zwischen Seite 2 der Suchergebnisse und der Position als direkte KI-Antwort ausmacht.

E-E-A-T in Code gießen – Das Autoren-Profil

Lassen Sie uns noch einmal einen Blick auf den Code-Block aus dem vorherigen Schritt werfen. Dort gab es einen unscheinbaren Abschnitt:

JSON

"author": {

"@type": "Person",

"name": "Max Mustermann",

"jobTitle": "Senior Software Architect",

"url": "https://technikermagazin.de/autoren/max-mustermann"

}

Dieser kleine Block ist in der heutigen SEO-Realität oft wichtiger als der Artikel selbst. Warum? Weil wir uns mitten in einer massiven Vertrauenskrise des Internets befinden.

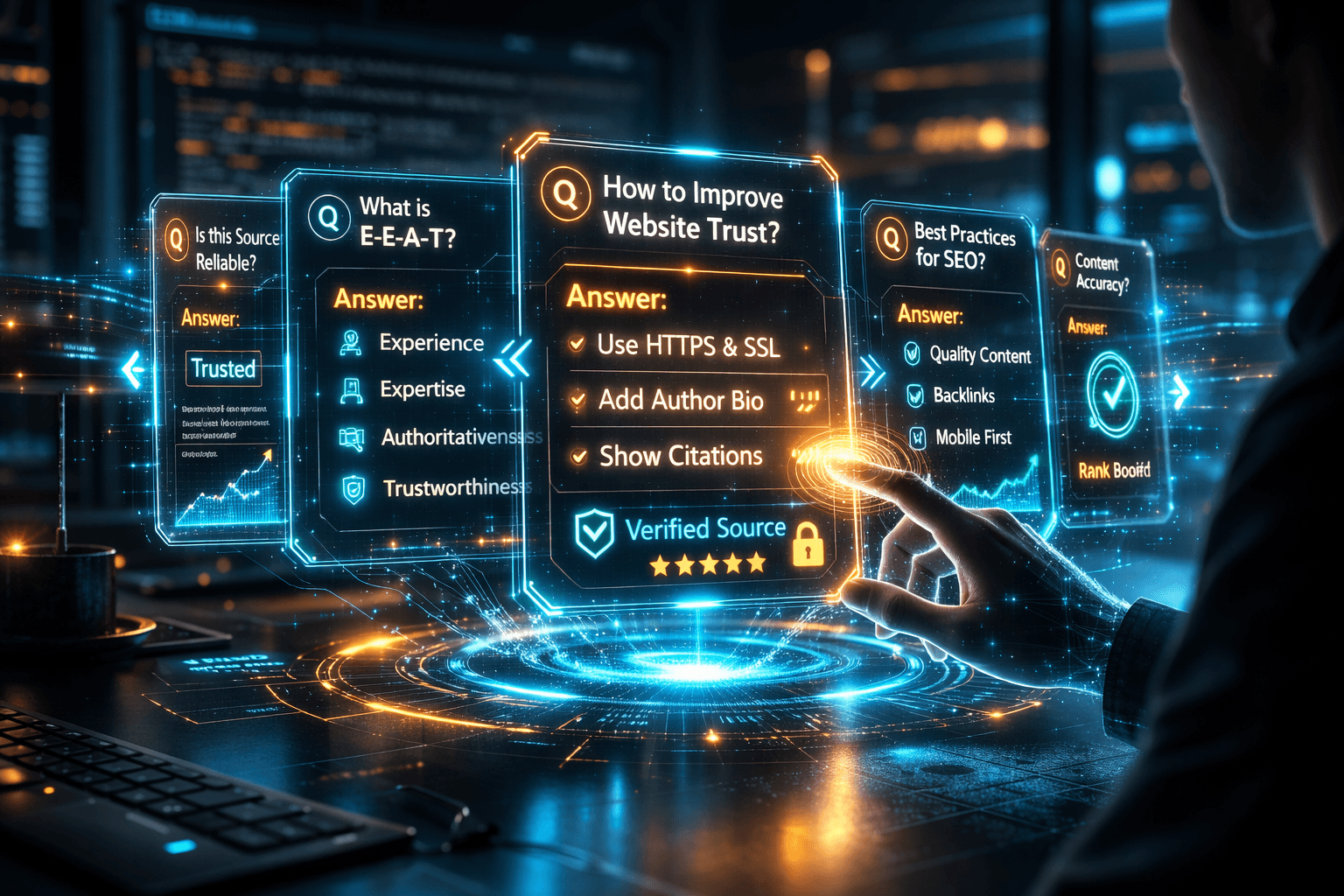

Nach den verheerenden Google Spam Updates im Februar und August 2025, die gnadenlos gegen massenhaft produzierte KI-Inhalte vorgingen, hat sich die Suchmaschine auf ein zentrales Konzept zurückgezogen: E-E-A-T (Experience, Expertise, Authoritativeness, and Trustworthiness).

Das Problem: Google und große Sprachmodelle (LLMs) können nicht einfach "fühlen", ob ein Text von einem echten Experten oder von einem halluzinierenden Bot geschrieben wurde. Die neuesten Studien zeigen deutlich: KI-Modelle bewerten und zitieren Texte signifikant anders (und wohlwollender), wenn sie den Autor eindeutig verifizieren können. "LLMs sind am sichersten, wenn sie zur Unterstützung des Denkens eingesetzt werden, nicht um es zu ersetzen: nützliche Assistenten, aber niemals Richter", hieß es kürzlich in einer Analyse zur KI-Modellierung. Wenn die KI Sie nicht erkennt, zitiert sie Sie nicht.

Hier kommt das Person-Schema ins Spiel. Wenn Sie auf Ihrer News-Seite nur einen einfachen Byline-Text ("Von Max Mustermann") unter die Überschrift klatschen, muss die KI raten, wer das ist.

Durch das JSON-LD Schema verschränken Sie den Namen mit echten Daten. Die Eigenschaft jobTitle ("Senior Software Architect") signalisiert der Maschine sofort die fachliche Qualifikation. Das Feld url verweist auf die zentrale Autorenseite. Auf dieser Autorenseite wiederum sollte ein weiteres, eigenständiges Schema (ProfilePage) liegen, das auf die LinkedIn-Profile, veröffentlichte Bücher oder Fachvorträge des Autors verweist (z. B. über das Attribut sameAs).

Sie bauen damit einen "Knowledge Graph" (Wissensgraphen) um Ihre Redakteure. Sie sagen der KI nicht nur: "Hier ist ein Artikel." Sie sagen: "Hier ist ein technischer Deep-Dive, geschrieben von jemandem, der seit 15 Jahren Enterprise-Systeme baut. Hier sind seine verifizierten Social-Media-Profile und hier ist sein Arbeitgeber."

Für News-Publisher und Tech-Magazine ist die korrekte Auszeichnung von Autorenseiten heute keine SEO-Kür mehr. Es ist die digitale Eintrittskarte, um von den Algorithmen überhaupt noch ernst genommen zu werden.

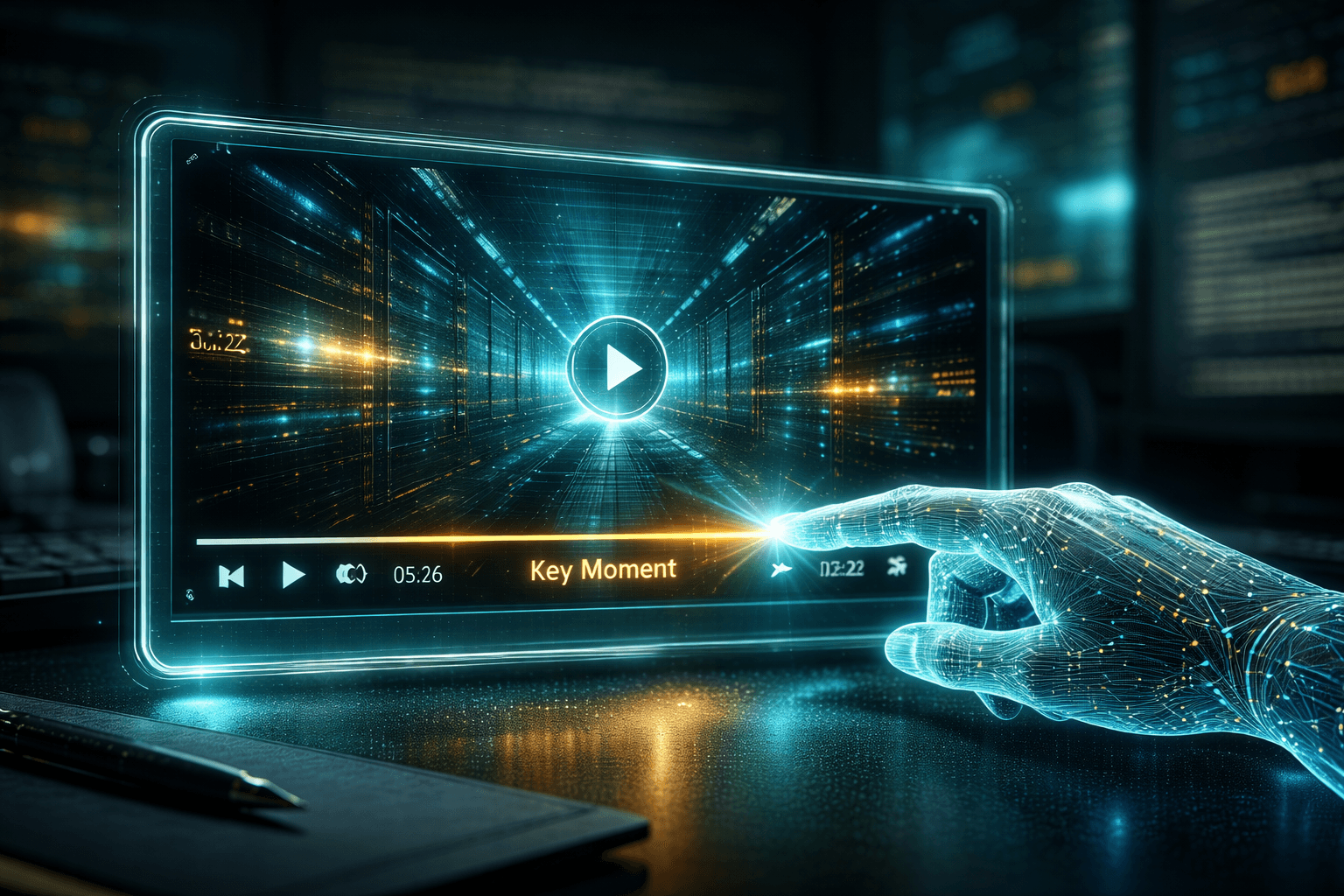

Visueller Content und die Magie der "Key Moments"

Texte strukturiert aufzubereiten, ist die Pflicht. Die Kür im Jahr 2026 ist jedoch visueller Content.

Stellen Sie sich vor, Sie haben ein hervorragendes, 20-minütiges Video-Tutorial darüber gedreht, wie man eine lokale KI-Workstation zusammenbaut. Für den menschlichen Betrachter ist das Video ein Genuss. Für einen Google-Bot oder ein LLM ist eine nackte .mp4-Datei jedoch wie eine verschlossene Blackbox. Die Maschine sieht vielleicht den Dateinamen, aber sie hat keine Ahnung, was in Minute 12 passiert.

Wenn wir wollen, dass Google unser Video in den Suchergebnissen anzeigt, müssen wir die Box öffnen. Das tun wir mit dem VideoObject-Schema.

Mit diesem Markup übergeben wir die grundlegenden Metadaten: Titel, Beschreibung, das Upload-Datum und – extrem wichtig – eine saubere Thumbnail-URL. Doch das reicht heute nicht mehr aus, um den Nutzer wirklich zu fesseln. Der moderne Suchmaschinen-Nutzer (und auch die KI, die Antworten zusammenfasst) hat keine Geduld. Er will nicht 20 Minuten warten, um die Antwort auf seine spezifische Frage zu finden.

Hier kommt das Konzept der "Key Moments" (Schlüsselmomente) ins Spiel, das die Video-Suche revolutioniert hat.

Es gibt zwei Wege, wie Sie der KI beibringen, zu den wichtigsten Stellen in Ihrem Video zu springen:

Die Automatik (

SeekToAction): Wenn Sie dasSeekToAction-Markup in IhrVideoObjectintegrieren, erlauben Sie Google, die Audiospur und den visuellen Inhalt Ihres Videos automatisch zu analysieren und selbstständig Kapitelmarken zu setzen. Sie sagen der Maschine quasi: "Hier ist das Video, such dir die wichtigsten Stellen selbst heraus." Die einzige Voraussetzung: Die URL Ihrer Webseite muss Parameter unterstützen, die das Video an einer bestimmten Stelle starten lassen (z. B.example.com/video?t=32).Die absolute Kontrolle (

Clip): Wenn Sie nichts dem Zufall (oder der KI) überlassen wollen, nutzen Sie dasClip-Markup. Hier definieren Sie als Redakteur oder Entwickler exakt den Start- und Endpunkt eines Segments. Sie können beispielsweise festlegen, dass das Segment von Sekunde 120 bis 180 den Titel "GPU einbauen" trägt. Google priorisiert diese manuell gesetztenClip-Markups immer gegenüber der eigenen Automatik.

Warum ist das so mächtig? Wenn ein Nutzer nun Google fragt: "Wie baue ich eine GPU in eine Workstation ein?", zeigt die Suchmaschine nicht nur Ihren Artikel an. Sie zeigt exakt das Video-Snippet an und lässt es genau bei Minute 2:00 starten.

Sie haben der Maschine nicht nur das Lesen beigebracht – Sie haben ihr beigebracht, für den Nutzer vorzuspulen.

Der Kampf um den "Zero-Click" – FAQs und Carousels

In der Welt des klassischen SEO gab es nur ein echtes Ziel: den Klick. Im Jahr 2026, der Blütezeit der generativen Suchmaschinen und "Zero-Click-Searches", ist das oft ein Kampf gegen Windmühlen. Die Nutzer stellen eine Frage und wollen die Antwort sofort – am besten mundgerecht aufbereitet von der KI, ohne eine Website laden zu müssen.

Ist das unser Ende als Content-Produzenten? Nein. Es ist wie bei einem exzellenten Restaurant, das kostenlose, unwiderstehliche Häppchen direkt vor der Tür anbietet. Wir beantworten die dringlichste Frage sofort und etablieren so viel Vertrauen, dass der Nutzer freiwillig das Hauptgericht (unseren ausführlichen Artikel) bestellt.

Die effektivsten Werkzeuge dafür sind das FAQPage-Schema und die neuen Carousel-Markups.

Lassen Sie uns mit dem FAQPage-Markup beginnen. Wenn wir am Ende unseres Artikels über "Lokale KI-Hardware" drei extrem spezifische Fragen beantworten, überlassen wir es nicht dem Zufall, ob die KI das erkennt. Wir verpacken es in JSON-LD:

JSON

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [{

"@type": "Question",

"name": "Wie viel VRAM benötige ich für das LLaMA 3 Modell lokal?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Für ein quantisiertes 70B-Modell benötigen Sie mindestens 48 GB VRAM. Dies lässt sich am besten durch den Verbund von zwei RTX 4090 Grafikkarten erreichen."

}

}]

}

Wenn ein Sprachmodell (wie Gemini oder ChatGPT) nun von einem Nutzer genau diese Hardware-Frage gestellt bekommt, greift es bevorzugt auf verifizierte Answer-Blöcke zurück, anstatt blind im Textabsatz zu wühlen. Sie werden zur zitierten Primärquelle.

Doch Google geht mittlerweile noch einen Schritt weiter. Das kürzlich aus der Beta-Phase entwachsene Carousel Structured Data erlaubt es uns, Listen und Zusammenfassungen als interaktive, wischbare Karten (Cards) direkt in die Suchergebnisse zu pushen.

Wenn Sie einen Artikel über die "Die 5 besten KI-Frameworks 2026" schreiben, nutzen Sie das ItemList-Schema in Kombination mit dem Host-Karussell-Markup. Sie definieren jedes Framework als ListItem. Das Ergebnis? Google generiert ein visuell dominantes Karussell ganz oben auf der Seite, das Bilder, Preise und kurze Bewertungen enthält.

Der Nutzer wischt durch Ihre Empfehlungen, noch bevor er Ihre Website überhaupt betreten hat. Sie besetzen damit massiv "Screen-Real-Estate" (Bildschirmplatz) und drängen die generischen, nicht-ausgezeichneten Inhalte der Konkurrenz weit nach unten.

In dieser Phase des Webs gilt: Wer der Maschine die Daten nicht in ihrem eigenen, tabellarischen Format (JSON) liefert, wird schlichtweg übersehen.

Das Endspiel – MCP und das "Agentic Web"

Wir haben der Maschine nun das Lesen beigebracht. Wir haben unsere Tech-Artikel, unsere Autoren und unsere Videos mit JSON-LD so ausgezeichnet, dass große Sprachmodelle (LLMs) sie verstehen, zitieren und in den Suchergebnissen prominent platzieren.

Doch die Evolution des Internets im Jahr 2026 bleibt hier nicht stehen. Wir bewegen uns rasant vom "Semantic Web" (das Web der Bedeutungen) hin zum "Agentic Web" (das Web der handelnden Agenten).

Was bedeutet das? Nutzer suchen nicht mehr nur nach Informationen. Sie delegieren Aufgaben. Ein Nutzer sagt heute zu seinem KI-Assistenten: "Lies den neuesten Testbericht zur RTX 5090 auf technikermagazin.de, vergleiche die Spezifikationen mit meiner aktuellen Hardware und leg die Karte in meinen bevorzugten Shop in den Warenkorb."

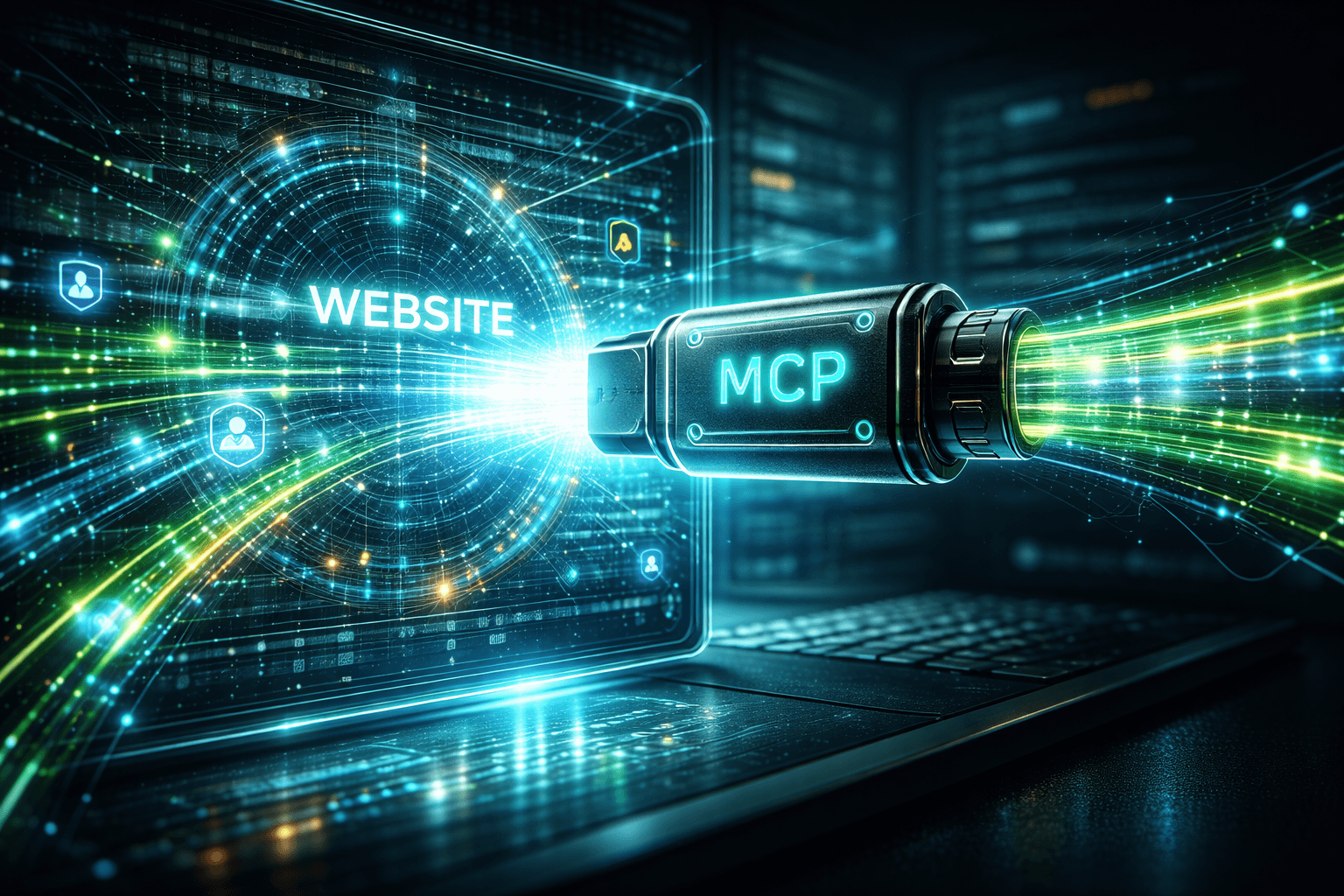

Damit eine KI solche komplexen Aktionen über verschiedene Webseiten hinweg ausführen kann, reicht reines HTML-Scraping längst nicht mehr aus. Hier betritt das Model Context Protocol (MCP) die Bühne.

Das MCP wird in Entwicklerkreisen oft als der "USB-C-Stecker der KI-Integration" bezeichnet. Es ist eine standardisierte Sprache, die es KI-Agenten erlaubt, ohne aufwendige Custom-APIs direkt mit Datenbanken, Tools und Webseiten zu kommunizieren. Aktuell gibt es bereits über 5.800 offizielle MCP-Server, die von Giganten wie Anthropic, OpenAI und Google nativ unterstützt werden.

Die neueste Erweiterung dieses Standards für uns Webseitenbetreiber ist WebMCP. Wenn ein autonomer Agent Ihre Webseite besucht, scannt er nicht nur den Text. Über WebMCP sucht er nach einem maschinenlesbaren Inhaltsverzeichnis Ihrer Funktionen und Daten. Wenn Ihr Code nicht sauber strukturiert ist, wenn Entitäten nicht klar durch Schema Markup definiert sind, bricht der Agent seinen Versuch ab. Die "Schnittstelle" passt nicht.

Ihre strukturierten Daten (JSON-LD) sind das absolute Fundament, auf dem diese neuen Protokolle aufbauen. Ein sauberes Product- oder TechArticle-Schema ist der allererste Handschlag zwischen Ihrer Webseite und dem autonomen Agenten. Ohne diesen Handschlag findet keine Interaktion statt.

Vom Coder zum Daten-Architekten

Wir begannen diesen Artikel mit der Metapher, einem Kind Quantenphysik zu erklären. Die gute Nachricht ist: Wir müssen nicht mehr wild mit den Händen fuchteln. Wir haben mit JSON-LD und Schema.org eine gemeinsame, universelle Sprache gefunden.

Wenn Sie im Jahr 2026 Inhalte publizieren, schreiben Sie immer für zwei völlig unterschiedliche Zielgruppen:

Den Menschen: Er braucht emotionale Hooks, klare Meinungen (Opinionated Journalism) und eine ansprechende visuelle Aufbereitung.

Die Maschine: Sie braucht nackte, strukturierte Entitäten im

<head>-Bereich, kryptografisch verifizierte Autoren-Profile (E-E-A-T) und definierte "Key Moments" in Videos.

Hören Sie auf, Ihre Artikel nur als Text zu betrachten. Betrachten Sie jede Seite als eine API-Schnittstelle zu den größten und mächtigsten Antwortmaschinen der Welt. Wer seine Daten heute nicht mundgerecht strukturiert, wird morgen schlichtweg nicht mehr zitiert.